AI 시대 기술기반 규제 도구(Reg Tech) 현황과 전망 : 플랫폼 자율규제와 KISO 욕설 방지 시스템(KSS)을 중심으로

1. 기술 기반적 규제의 중요성과 기술기반 규제 도구(Reg Tech)

디지털 플랫폼 환경에서 기술 기반 규제의 중요성이 급격히 증대되고 있다. 이는 크게 세 가지 요인에서 기인한다. 첫째, 콘텐츠의 폭발적 증가와 실시간성이다. 매초 수만 건의 콘텐츠가 생성되는 환경에서 인력 기반 모니터링만으로는 효과적인 대응이 불가능해졌다. 둘째, 콘텐츠의 복잡성과 교묘함이 증가하고 있다. 특히 생성형 AI의 등장으로 고품질의 딥페이크, 가짜뉴스, 혐오 표현이 더욱 정교하게 제작되면서 이를 식별하기 위한 첨단 기술의 필요성이 커지고 있다. 셋째, 크로스 플랫폼 위협이 확산되고 있다. 유해 콘텐츠가 단일 플랫폼에 국한되지 않고 여러 플랫폼을 넘나들며 확산되는 현상이 일반화되면서, 플랫폼 간 협력적 대응과 통합적 기술 솔루션이 요구되고 있다(Starbird, Arif, & Wilson, 2022; Barrett, Hendrix, & Sims, 2023).

이러한 환경에서 주목받는 개념이 바로 레그테크(RegTech)이다. 레그테크는 규제(Regulation)와 기술(Technology)의 합성어로, 규제 준수와 모니터링을 위해 첨단 기술을 활용하는 분야를 의미한다. 이 용어는 학계와 산업계에서 다양한 표현으로 사용되고 있다. 소셜 미디어 분야에서는 ‘콘텐츠 모더레이션 기술(Content Moderation Technology)’이라는 표현이 가장 보편적으로 사용되며(Roberts, 2023), 기업의 자체적인 규제 준수를 강조할 때는 ‘자율규제 기술(Self-regulatory Technology)’이라는 용어가 선호된다(Flew, Martin, & Suzor, 2022). 또한 ‘컴플라이언스 테크(Compliance Tech)’는 레그테크와 유사하지만 더 넓은 의미로 사용되며(Butler & O’Brien, 2022), ‘디지털 거버넌스 툴(Digital Governance Tools)’은 디지털 환경에서의 규제와 관리를 강조하는 표현이다(Pasquale, 2022).

콘텐츠 측면에 초점을 맞춘 ‘콘텐츠 거버넌스 시스템(Content Governance Systems)’이라는 용어도 사용되며, 최근 플랫폼 기업들 사이에서는 이용자 보호를 강조하는 ‘신뢰 및 안전 기술(Trust and Safety Technology)’이라는 표현이 확산되고 있다(Douek & Klonick, 2024). 플랫폼 특화된 규제 기술을 지칭할 때는 ‘플랫폼 거버넌스 기술(Platform Governance Technology)’이라는 용어가 활용된다(Gorwa, Binns, & Katzenbach, 2023). 이처럼 다양한 용어들이 맥락에 따라 사용되고 있지만, 본고에서는 기술 기반 규제 도구의 포괄적 개념으로 ‘레그테크’라는 용어를 주로 사용하고자 한다.

레그테크는 초기에는 금융권에서 규제 준수 비용을 절감하기 위해 도입되었으나, 현재는 소셜미디어와 콘텐츠 플랫폼으로 그 영역이 확장되고 있다(Arner, Zetzsche, Buckley, & Veidt, 2023). 디지털 플랫폼 분야에서 레그테크는 AI, 머신러닝, 자연어 처리 등의 기술을 활용하여 유해 콘텐츠를 탐지하고 차단하는 데 활용된다.

글로벌 레그테크 시장은 빠르게 성장하고 있으며, 2032년까지 연평균 성장률 23.6%로 증가하여 859억 달러에 이를 것으로 전망된다(Grand View Research, 2023). 이는 레그테크가 단순한 기술적 도구를 넘어 디지털 생태계의 건전성을 유지하기 위한 필수적인 인프라로 인식되고 있음을 보여준다.

Floridi, Cowls와 Beltrametti(2022)는 레그테크의 발전이 네 단계로 이루어진다고 설명한다. 첫째, 단순한 규칙 기반 시스템, 둘째, 패턴 인식과 머신러닝 적용, 셋째, 자연어 처리와 맥락 이해, 넷째, 예측적 규제와 선제적 대응이다. 현재 디지털 플랫폼 분야의 레그테크는 주로 2~3단계에 있으며, 생성형 AI의 등장으로 4단계로 진화하고 있다.

2. 플랫폼 자율규제에서 적용되고 있는 Reg Tech

플랫폼 기업들은 다양한 레그테크 솔루션을 개발하고 적용해 자율규제를 강화하고 있다. 이러한 기술 기반 자율규제는 크게 네 가지 유형으로 분류할 수 있다.

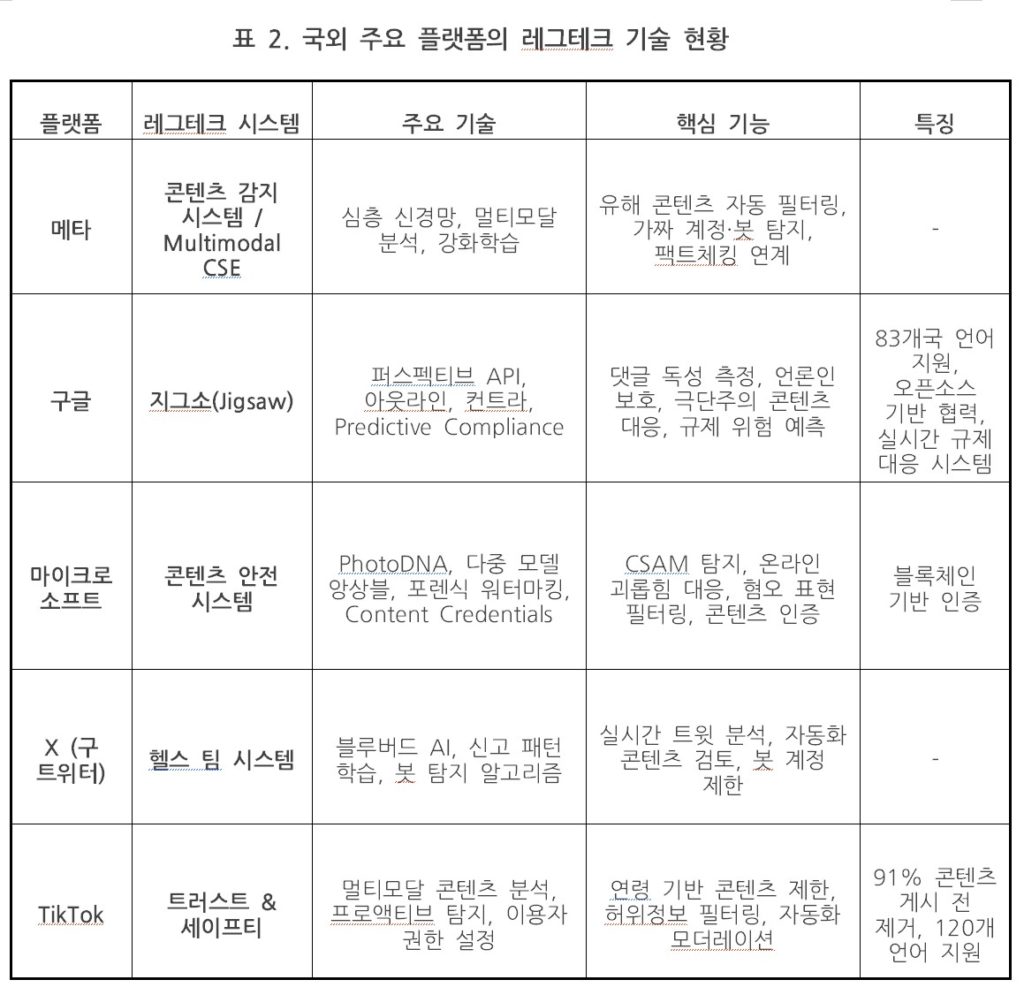

첫째, AI 기반 콘텐츠 모니터링 시스템이다. 메타의 ‘콘텐츠 감지 시스템’은 심층 신경망을 활용하여 텍스트, 이미지, 영상을 실시간으로 분석하고 유해 콘텐츠를 자동으로 필터링한다. 2023년에는 멀티모달 분석 시스템인 ‘Multimodal Community Standards Enforcement System’을 도입하여 텍스트, 이미지, 오디오를 통합적으로 분석하는 능력을 강화했다(Meta, 2023).

둘째, 딥페이크 탐지 기술이다. 마이크로소프트의 ‘PhotoDNA’는 아동 성착취물(CSAM) 탐지에 특화된 기술로, 얼굴 표정, 눈 깜빡임 패턴, 음성 일치도 등을 분석하여 조작된 미디어를 식별한다. 또한 마이크로소프트는 ‘Content Credentials Consortium’과 협력하여 블록체인 기반의 콘텐츠 인증 시스템을 개발하고 있다(Microsoft, 2024).

셋째, 가짜뉴스 판별 기술이다. 구글의 ‘지그소(Jigsaw)’는 ‘퍼스펙티브 API’를 통해 댓글의 독성 수준을 측정하고, ‘컨트라(Contra)’를 통해 극단주의 콘텐츠에 대응한다. 또한 ‘Predictive Compliance Framework’를 통해 규제 위험을 사전에 예측하고 대응하는 시스템을 구축했다(Google, 2023).

넷째, 혐오 표현 필터링 시스템이다. 국내에서는 네이버의 ‘클린봇’이 대표적인 사례로, 딥러닝 모델을 통해 맥락을 이해하고 악성 댓글을 필터링한다. 2020년 18.5%에서 2023년 8.9%로 악성 댓글 노출을 크게 감소시키는 성과를 거두었다(Hwang, 2024).

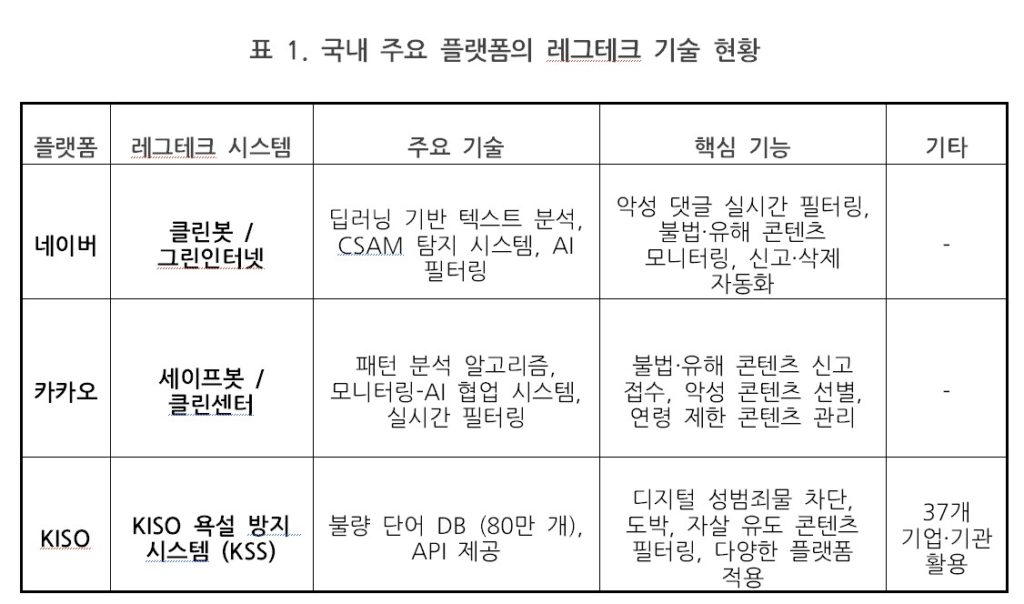

국내외 플랫폼 기업들은 다양한 레그테크 솔루션을 개발하고 적용해 자율규제를 강화하고 있다. 주요 플랫폼들의 레그테크 기술 현황을 국내와 국외로 구분해 살펴보면 다음과 같다.

국내 플랫폼들의 경우, 네이버는 ‘그린인터넷 캠페인’을 통해 CSAM 탐지 AI 시스템, 댓글 및 게시물 자동 모니터링, 신고 및 삭제 자동화 처리 시스템을 운영하고 있다. 카카오는 ‘클린센터’를 통해 AI와 모니터링 전문 팀의 협업으로 악성 콘텐츠를 선별하고, ‘세이프봇’을 통해 2023년 부적절 언어 사용을 94.7% 감소시켰다(Hwang, 2024).

주목할 점은 이러한 기술들이 단순히 키워드 기반 필터링을 넘어 맥락과 의도를 이해하는 방향으로 진화하고 있다는 것이다. 예를 들어, 풍자와 혐오를 구분하고, 은유적 표현 속에 숨겨진 악의적 의도를 파악하는 능력이 향상되고 있다. 또한 플랫폼별로 개별적인 노력에서 나아가 산업 전체의 협력적 자율규제 체계로 발전하고 있는 추세이다.

3. Reg Tech 관점에서 KISO의 KSS의 기술적 특성과 거버넌스 특징

(사)한국인터넷자율정책기구(KISO)의 KISO 욕설 방지 시스템(KISO Safeguard System, KSS)은 국내 인터넷 플랫폼 산업의 대표적인 공동 자율규제 시스템으로, 레그테크 관점에서 주목할 만한 기술적 특성과 거버넌스 특징을 갖추고 있다.

1) KSS의 기술적 특성

KSS(KISO Safeguard System)는 국내 대표 포털인 네이버와 카카오로부터 제공받은 욕설·비속어 데이터베이스(DB)를 활용하여 개발된 API 시스템이다. 네이버와 카카오는 건강한 인터넷 문화 조성을 위해 자체 구축한 욕설·비속어 DB를 KISO에 제공함으로써, 다양한 인터넷 서비스에 적용될 수 있는 기반을 마련하였다(KISO, 2024).

이 시스템은 네 가지 핵심 기술적 특성을 갖추고 있다. 첫째, 문장 내 욕설·비속어를 빠르고 정확하게 검사해 통계 분석을 제공하는 ‘우수한 품질’이다. 둘째, 서비스별 맞춤형 카테고리 분류와 선별적 DB 활용이 가능한 ‘이용자 맞춤 제공’ 기능이다(박소연 & 임용관, 2023). 셋째, AWS 클라우드 기반의 안정적 서비스와 부하 격리 기능을 갖춘 ‘안정적 인프라’이다. 넷째, 장애 발생 시 즉시 무부하 응답 모드로 전환되는 ‘장애 대응’ 시스템이다(KISO, 2024). 이러한 특성들은 다양한 인터넷 서비스 환경에서 효과적인 콘텐츠 필터링을 가능하게 한다.

2) KSS의 거버넌스 특징

KSS의 거버넌스 구조는 기술적 측면 못지않게 중요한 특징이다. KSS의 거버넌스 특징은 크게 네 가지로 요약할 수 있다.

첫째, ‘협력적 자율규제’ 모델이다. KSS는 개별 기업 차원의 자율규제를 넘어 산업 전체의 협력적 자율규제 체계를 구축하고 있다. 네이버, 카카오, 네이트커뮤니케이션즈 3개 회원사가 DB를 제공하고 있으며, 현재 39개 기업과 조직이 이 시스템을 활용하고 있다(KISO, 2024). 이러한 협력적 접근은 라도(Rado, 2023)가 제시한 ‘집단적 자율규제(collective self-regulation)’ 모델과 유사하며, 개별 기업의 한계를 극복하고 산업 전체의 대응 역량을 강화하는 효과가 있다.

둘째, ‘자율규제DB 소위원회’를 통한 전문적인 심의 체계이다. KISO는 기술분과 산하에 자율규제DB 소위원회를 두어 ‘청소년보호 검색어 가이드라인’ 등 구체적인 판단 기준을 마련하고, 이를 기반으로 심의를 진행한다. 이는 단순한 기술적 솔루션을 넘어, 정책적 판단과 거버넌스가 결합된 형태이다(김성중 & 박지현, 2023). 이러한 접근은 자율규제의 정당성과 전문성을 확보하는 데 중요한 요소로, 마스덴(Marsden, 2023)이 강조한 ‘규범적 거버넌스(normative governance)’의 핵심 요소를 포함하고 있다.

셋째, ‘투명성과 설명가능성’에 대한 강조이다. KSS는 기술적 결정에 대한 설명 체계를 갖추고 있으며, 연간 운영 결과를 공개하여 시스템의 투명성을 확보하고 있다. 이는 레그테크의 신뢰성을 높이는 중요한 요소이다(박지원, 2024). 밀러(Miller, 2023)는 AI 기반 의사결정 시스템의 투명성이 사회적 수용성과 책임성의 핵심 요소임을 강조하고 있으며, KSS는 이러한 원칙을 실천하고 있다.

넷째, ‘윤리적 가이드라인’과의 연계이다. KISO는 2023년 ‘챗봇 윤리 가이드라인’과 ‘혐오 표현 자율정책 가이드라인’을 개발하여 KSS의 운영 방향을 제시하고 있다. 특히 챗봇 윤리 가이드라인은 인간 존엄성과 권리 존중, 개인정보 보호와 정보 보안, 다양성 존중, 투명성, 책임성이라는 5가지 기본 원칙을 기반으로 하여 생성형 AI 시대의 레그테크 방향을 제시한다(Hwang, 2024). 이는 플로리디 등(Floridi et al., 2022)이 제안한 ‘AI 윤리적 거버넌스 프레임워크’와 맥을 같이하며, 기술 발전에 따른 윤리적 고려사항을 선제적으로 반영하고 있다.

KSS의 이러한 거버넌스 특징은 기술과 정책의 균형적 접근을 구현하며, 중소 플랫폼 기업들도 고도화된 레그테크를 활용할 수 있게 하여 인터넷 생태계 전반의 이용자 보호 수준을 향상시키는 데 기여하고 있다.

4. 향후 레그테크(Reg Tech) 발전 방향: 한국적 맥락에서의 제언

디지털 플랫폼 환경에서 레그테크의 중요성은 더욱 커질 것으로 전망된다. 특히 생성형 AI의 발전으로 인한 딥페이크와 허위정보의 증가, 크로스 플랫폼 위협의 확산, 국경을 초월한 콘텐츠 유통 등 새로운 도전 과제들이 등장하고 있다. 이러한 환경에서 레그테크의 발전 방향과 필요성을 네 가지 측면에서 살펴볼 수 있다.

첫째, 한국어의 언어적 특성과 한국 인터넷 문화를 반영한 멀티모달 분석 기술 개발이 필요하다. 텍스트, 이미지, 영상, 음성 등 다양한 형태의 데이터를 종합적으로 분석하여 유해 콘텐츠를 정확하게 탐지하고 차단해야 한다. 특히, 국내 생성형 AI 콘텐츠의 특성을 고려한 워터마킹 기술 개발이 시급하다. KISO가 네이버, 카카오와 공동으로 개발한 KSS 모델을 확장하여 텍스트뿐 아니라 이미지, 영상 콘텐츠까지 포괄하는 통합적 자율규제 시스템으로 발전시킬 필요가 있다.

둘째, 기존의 KISO 중심 협력 모델을 넘어, 대형 플랫폼, 중소 플랫폼, 정부, 시민사회 등 다양한 이해관계자가 참여하는 확장된 거버넌스 모델을 구축해야 한다. 플랫폼 간 정보 공유 및 협력을 강화하고, 공동 대응 체계를 구축해 유해 콘텐츠 확산을 효과적으로 방지해야 하는 것이 필요하다.

셋째, 국제 협력 및 정보 공유를 강화하는데 노력해야 한다. 해외 플랫폼 기업 및 관련 기관과의 협력을 통해 레그테크 기술 및 정책 동향을 공유하고, 국제적인 규제 협력 체계를 구축해야 한다. 또한, 한국의 KISO와 KSS 모델을 아시아 지역을 넘어 글로벌 스탠다드로 발전시켜, 국제 사회에서 한국의 레그테크 리더십을 확보해야 할 것이다.

[참고문헌]

- Arner, D. W., Zetzsche, D. A., Buckley, R. P., & Veidt, R. (2023). Regulating digital platforms: The case for RegTech and SupTech. Journal of Banking Regulation, 24(3), 230-245. https://doi.org/10.1057/s41261-022-00189-1

- Barrett, P., Hendrix, J., & Sims, G. (2023). Countering synthetic media: Current challenges and future directions in deepfake detection. Journal of Media Technologies, 19(3), 325-347. https://doi.org/10.1080/24701556.2023.2176453

- Butler, T., & O’Brien, L. (2022). Understanding RegTech for digital regulatory compliance. In Disrupting Finance (pp. 85-102). Palgrave Pivot, Cham. https://doi.org/10.1007/978-3-030-02330-0_6

- Douek, E., & Klonick, K. (2024). The new governors: The people, rules, and processes governing online speech. Harvard Law Review, 137(2), 598-670.

- Flew, T., Martin, F., & Suzor, N. (2022). Internet regulation as media policy: Rethinking the question of digital communication platform governance. Journal of Digital Media & Policy, 13(1), 5-19. https://doi.org/10.1386/jdmp_00075_1

- Floridi, L., Cowls, J., & Beltrametti, M. (2022). AI regulation between legal challenges and ethical concerns: The EU approach. Philosophy & Technology, 35(4), 1-26. https://doi.org/10.1007/s13347-022-00550-2

- Google. (2023). Google Safety & Security Report 2023. https://safety.google/intl/en_us/safety-and-security-report-2023/

- Gorwa, R., Binns, R., & Katzenbach, C. (2023). Algorithmic content moderation: Technical and political challenges in the automation of platform governance. Big Data & Society, 10(1), 1-15. https://doi.org/10.1177/20539517231158995

- Grand View Research. (2023). RegTech Market Size, Share & Trends Analysis Report, 2023-2032. https://www.grandviewresearch.com/industry-analysis/regulatory-technology-market

- Halevy, A., Ferrer, C. C., Ma, H., Ozertem, U., & Pantel, P. (2022). Multimodal content moderation: Challenges, technologies, and implications. Proceedings of the IEEE, 110(10), 1574-1599. https://doi.org/10.1109/JPROC.2022.3184243

- Hwang, Yongsuk. (2024). Automated, Technology-Based Digital Human Rights Protection and Self-Regulation on Korean Digital Platforms. Internet Governance Forum 2024, Riyadh, Saudi Arabia.

- Kirchner, L., & Goldstein, M. (2023). Inside the race to build AI content watermarks. The Markup, July 18. https://themarkup.org/news/2023/07/18/inside-the-race-to-build-ai-content-watermarks

- Marsden, C. (2023). Internet co-regulation and constitutionalism: Towards a more nuanced view. Global Constitutionalism, 12(1), 98-122. https://doi.org/10.1017/S2045381721000332

- Meta. (2023). Introducing our Multimodal Community Standards Enforcement System. https://ai.facebook.com/blog/multimodal-community-policy-enforcement/

- Microsoft. (2024). Digital safety report 2024: Building safer online experiences. https://www.microsoft.com/en-us/digital-skills/digital-safety-report

- Miller, T. (2023). Explainable AI: Making AI algorithms transparent and trustworthy. Communications of the ACM, 66(4), 62-69. https://doi.org/10.1145/3571730

- Newman, N., Fletcher, R., Robertson, C. T., Eddy, K., & Nielsen, R. K. (2022). Reuters Institute Digital News Report 2022. Reuters Institute for the Study of Journalism.

- Pasquale, F. (2022). The Black Box Society: The Secret Algorithms That Control Money and Information. Harvard University Press.

- Rado, N. (2023). Collective self-regulation in digital platforms: Challenges and opportunities. International Journal of Communication Law & Policy, 15(2), 213-238.

- Roberts, S. T. (2023). Behind the Screen: Content Moderation in the Shadows of Social Media. Yale University Press.

- Starbird, K., Arif, A., & Wilson, T. (2022). Disinformation as collaborative work: Implications for crisis informatics research. Proceedings of the ACM on Human-Computer Interaction, 3(CSCW), 24:1–24:26. https://doi.org/10.1145/3359229

- TikTok. (2023). Community guidelines enforcement report Q3 2023. https://www.tiktok.com/transparency/en/community-guidelines-enforcement-2023-3/

- Wojcik, S., Hughes, A., & Remy, E. (2023). Detecting bots and manipulation on social media: Challenges and advancements. Proceedings of the International AAAI Conference on Web and Social Media, 17(1), 1108-1117.

- Zhou, X., & Zafarani, R. (2023). A survey of fake news: Fundamental theories, detection methods, and opportunities. ACM Computing Surveys, 55(11), 1-40. https://doi.org/10.1145/3514228

- 김성중, & 박지현. (2023). 플랫폼 이용자 참여형 콘텐츠 모더레이션 모델 연구. 인터넷정보학회논문지, 24(5), 78-89. https://doi.org/10.7472/jksii.2023.24.5.78

- 박소연, & 임용관. (2023). 크로스 플랫폼 정보 검증 시스템 설계 및 구현. 정보과학회논문지, 50(9), 845-858. https://doi.org/10.5626/JOK.2023.50.9.845

- 이성호, & 김태호. (2023). AI 콘텐츠 규제 과정의 설명가능성 확보 방안. 과학기술법연구, 29(3), 167-195. https://doi.org/10.32430/ilst.2023.29.3.167

- 한국인터넷자율정책기구. (KISO). (2024). KISO 이용자보호시스템(KSS). https://www.kiso.or.kr/safeguard-system

이전 글

이전 글  다음 글

다음 글  구글 국내지도 국외반출 요청 이슈와 정책 시사점

구글 국내지도 국외반출 요청 이슈와 정책 시사점  국내 이커머스 시장 지형 분석 : 신세계-알리 동맹을 중심으로

국내 이커머스 시장 지형 분석 : 신세계-알리 동맹을 중심으로  우리의 지갑을 노리는 해커, 사이버 사기의 진화

우리의 지갑을 노리는 해커, 사이버 사기의 진화  디지털 화폐의 현황과 미래

디지털 화폐의 현황과 미래  트럼프 2기 글로벌 반도체 밸류체인의 불확실성과 한국의 대응 전략

트럼프 2기 글로벌 반도체 밸류체인의 불확실성과 한국의 대응 전략  부동산 직거래, 자율적 안전장치 구축 필요하다

부동산 직거래, 자율적 안전장치 구축 필요하다  포털의 사회적 책임, 현재와 미래

포털의 사회적 책임, 현재와 미래  TaaS(Transportation as a Service) 3.0의 시대

TaaS(Transportation as a Service) 3.0의 시대