‘AI+인간’ 콘텐츠 모더레이션과 자율규제의 함의

1. 서론

오늘날 인공지능(AI)은 그 어느 때보다 빠른 속도로 발전하고 있으며, 생성형 AI가 사회적 진보를 촉진할 것인지, 아니면 새로운 위험을 초래할 것인지에 대한 논의가 활발히 전개되고 있다. 뉴욕타임스는 생성형 AI가 급속히 확산되면서 사회 변혁 가능성과 위험성을 둘러싼 논쟁이 확산되고 있다고 보도했다.1

이러한 기술적 변화는 디지털 플랫폼 전반의 콘텐츠 모더레이션(content moderation) 방식에도 큰 변화를 가져왔다. 특히 페이스북, 인스타그램, X(구 트위터), 틱톡과 같은 소셜 미디어 플랫폼에 대한 규제 압박이 증대되면서 유해 콘텐츠를 보다 효과적으로 억제해야 할 필요성이 커졌고, 그 결과 AI와 인간이 결합된 하이브리드 콘텐츠 모더레이션 체계가 확산되고 있다.2

콘텐츠 모더레이션은 플랫폼 서비스 사업자가 자사의 이용정책 및 관련 법규에 비추어 불법·유해 콘텐츠로 판단한 이용자 생성 콘텐츠에 대하여 인적·기술적·관리적 수단을 활용해 그 게시·유통·확산을 제한하는 일련의 의사결정 과정을 통칭한다.3

하이브리드 콘텐츠 모더레이션 시스템은 AI의 대규모 탐지 능력과 인간의 맥락 판단을 결합함으로써 탐지 효율을 높이는 동시에 의사결정 과정에서 윤리적 안전장치를 유지하려는 접근이다. 일반적으로 AI는 유입되는 콘텐츠의 위험도를 먼저 추정하고, 사전에 정해 둔 기준값에 따라 해당 콘텐츠를 자동 삭제할지, 아니면 인간 검토자에게 넘길지를 결정한다.4 AI와 인간의 협업은 정책 위반 콘텐츠를 신속하게 걸러내면서도 합법적 콘텐츠의 과잉 차단을 줄이기 위한 현실적 대안으로 이해된다.

AI는 노골적인 콘텐츠를 신속하게 식별할 수 있지만, 문화적 뉘앙스나 맥락적 미묘함을 해석하는 능력은 여전히 한계를 보인다. 따라서 인간과 AI의 협력을 규율할 표준화된 프레임워크가 충분히 정립되지 않은 상황에서는, 윤리적 딜레마와 운영상의 비효율성을 초래할 수 있다.5

이 글은 글로벌 주요 플랫폼의 ‘AI+인간’ 모더레이션 현황과 자동화의 구조적 한계를 살펴보고, 국내외 사례를 바탕으로 자율규제 기구가 어떤 역할을 수행할 수 있는지를 검토한다.

2. 콘텐츠 모더레이션의 현황

가. 자동화 모더레이션의 부상

콘텐츠 모더레이션은 플랫폼의 정책 기준, 이용자의 기대, 규제 체계를 조화시키며 안전하고 포용적인 온라인 환경을 조성하는 데 핵심적인 역할을 수행한다. 이는 단순히 기술적 운영의 문제가 아니라 표현의 자유와 이용자 보호 사이에서 사회적 신뢰를 어떻게 설계할 것인가라는 질문과 맞닿아있다.6

전통적인 모더레이션 방식은 먼저 플랫폼 정책을 세부 판단 기준으로 구체화하고, 이를 기반으로 인간 검토자가 개별 사례에 적용하거나, 머신러닝 모델 학습을 위한 데이터셋에 주석을 부여하는 방식으로 이루어져 왔다. 이러한 접근은 일정 수준의 일관성과 통제 가능성을 확보할 수 있다는 장점이 있지만, 정책 변화에 대한 대응 속도가 느리고 대규모 데이터 처리에 상당한 비용과 시간이 소요된다는 한계를 안고 있었다.7

2020년대에 들어서면서 콘텐츠 유형의 다양화, 온라인 게시물의 폭발적 증가, 이용자 기반 확대, 모더레이션 운영 비용 상승 등이 맞물려 AI 기반 자동화 기술이 빠르게 확산됐다. 자동화는 인간 검토자 중심의 대응 조치의 한계를 극복하고, 불법‧유해 콘텐츠에 선제적이고 즉각적으로 대응하는 것을 가능하게 했다.8

그 규모가 어느 정도인지는 수치가 단적으로 보여준다. 유튜브에는 누적 200억 개가 넘는 동영상이 업로드돼 있고, 매일 100개국 이상의 이용자가 10억 시간 이상의 콘텐츠를 시청한다. 하루 평균 업로드되는 동영상만 2000만 개에 달하며 이는 2006년(하루 평균 약 6만5000개)과 비교하면 307배 증가한 수치다.9

Domo의 Data Never sleeps 12(2024) 보고서에 따르면 페이스북과 인스타그램의 릴스 재생 횟수는 매 분당 1억3890만 회, 유튜브 영상 조회수는 347만 회, 틱톡(TikTok) 영상 업로드 수는 1만6000건이다.10 이 규모에서 인간만으로 모더레이션을 수행하는 것은 불가능에 가까운 일이었고, 자동화는 전제 조건이 됐다.

그 결과 대부분의 주요 플랫폼에서 콘텐츠 검토 결정은 이미 상당 부분 자동화돼 있다. 인간에 의한 모더레이션은 규모를 확장하기 어렵고 비용도 크기 때문에 AI 모더레이션 도구는 사실상 업계 표준으로 자리잡았다.11

나. 자동화 모더레이션의 한계와 인간 개입의 필요성

2024년 1월 미 상원 아동 안전 청문회에서 메타 CEO인 마크 저커버그는 약 4만 명이 안전‧보안 업무를 담당하고 있으며, 2016년 이후 이 분야에 총 200억 달러를 투자했고 2023년 한 해에만 약 50억 달러를 투자했다고 밝혔다.12 콘텐츠 관리 기술에 상당한 투자가 이뤄졌음에도 불구하고, 유해 콘텐츠 관리의 복잡성으로 인해 플랫폼들은 여전히 다양한 어려움에 직면해 있다. 매일 생성되는 방대한 양의 콘텐츠는 관리자나 알고리즘이 모든 것을 포착하는 것을 사실상 불가능하게 만든다. 정보의 다양성과 맥락의 복잡성 앞에서 기존 자동화 모델은 여전히 한계를 드러낸다.13 유해 콘텐츠가 적절하게 관리되지 않을 경우 이용자들이 보호받지 못하게 되고 반대로 정당한 콘텐츠가 차단되면 이용자들의 자기표현과 공공 담론에 참여할 기회를 제한한다.14

이 문제는 2025년 말 구체적 사례를 통해 다시 가시화됐다. 2025년 12월 9일 포켓몬 관련 콘텐츠 크리에이터 스플래시플레이트(SplashPlate)의 채널이 유튜브의 우회 정책(circumvention policy) 위반을 이유로 종료됐다고 공개했다. 그는 다른 채널이 자신의 워터마크가 포함된 영상을 무단 재업로드한 뒤 삭제되었고, 유튜브의 자동화된 시스템이 이를 잘못 연결해 자신을 제재 회피자로 오인한 것으로 보인다고 설명했다. 초기 이의 제기 과정에서 그는 사실상 최종 결정 취지의 표준화된 응답(“termination is correct”)을 받았으며, 이후 온라인에서 사례가 확산된 뒤 12월 10일 채널이 복구됐다. 이 사례는 AI가 대규모 탐지와 신속한 집행에서 핵심 역할을 하더라도, 최종 판단과 이의 제기 단계에서는 인간 심의가 여전히 중요하다는 점을 보여준다.15

AI 기반 모더레이션은 불법성이 명확한 이미지 매칭이나 반복 패턴 탐지, 대규모 스팸 처리에 강점을 보이지만, 혐오표현, 풍자, 정치적 비판처럼 맥락 이해가 핵심인 표현에는 구조적 한계를 드러낸다.

최근 연구에서 다양한 동영상 이해 작업에서 다중모달 대규모 언어모델(MLLM)이 상당한 성능을 보인다는 점을 확인했다. 그러나 시각적·텍스트적 맥락을 미묘하게 해석해야 하는 콘텐츠 검토 영역에 이를 적용하는 연구는 아직 충분하지 않다.16 AI에만 의존할 경우 판단이 지나치게 단순화되고, 그 과정에서 간과하는 맥락적 뉘앙스가 모더레이션의 핵심 가치를 훼손할 수 있다는 우려가 제기된다.

실제 오분류 사례들을 보면 일본어로 제작된 카페인 중독에 관한 영상이 일본어 맥락을 제대로 처리하지 못한 AI에 의해 DAT(약물, 알코올, 담배) 카테고리로 잘못 분류되거나, 성인 콘텐츠에 ‘toys’라는 단어 하나 때문에 아동 콘텐츠로 오분류된 사례도 있었다. 1500개 동영상을 대상으로 GPT, Gemini, Llama 등 주요 MLLM과 인간 검토자를 비교한 연구에서, 인간 검토자는 전체 평가에서 F1 점수 0.98로 모든 AI 모델을 상회했다. 가장 성능이 높은 Gemini-2.0-Flash와 Gemini-2.0-Flash-Lite도 F1 점수 0.91 수준에 머물렀다. 다만 인간 검토 비용은 AI 대비 약 35배에 달했다.17 이는 비용 효율성 측면에서 인간 단독 검토보다 인간과 AI가 역할을 분담하는 혼합 모델이 더 현실적이라는 점을 시사한다.

현재 대부분의 AI 모더레이션 시스템은 영어 중심의 데이터로 학습돼 있어, 한국어나 소수 언어에서는 정치·사회적 맥락을 제대로 반영하지 못하는 오판이 늘어날 수 있다. 이는 특정 집단의 표현이 구조적으로 더 많이 삭제되거나, 어떤 집단을 향한 혐오표현이 상대적으로 방치되는 불균형을 초래할 수 있다.

특히 한국어 혐오표현은 맥락 의존성이 강하다. 동일한 표현이 친밀한 관계에서는 일상적 언어로, 공격적 맥락에서는 혐오표현으로 기능하는 경우가 적지 않아 기계적으로 판별하는 데 한계가 있다. 서사적·시각적 복합성까지 더해지면, 인간 심사자의 판단이 여전히 대체 불가능한 영역으로 남는다.18

전 세계 디지털 플랫폼이 혐오표현을 관리하고 있으나, 정책의 실행 방식과 해석 기준은 각국의 법률과 문화적 맥락에 따라 상당히 다르다. 유럽연합은 인종주의·제노포비아적 혐오표현을 형사 범죄로 규정해 강한 법적 제재를 가하는 반면, 미국은 수정헌법 제1조에 따라 폭력 선동과 직접 연결되지 않는 한 혐오표현도 보호 대상으로 본다.19

다. 글로벌 플랫폼 사례

자동화 모더레이션이 고도화되는 가운데, 주요 플랫폼들은 오히려 인간 개입이나 커뮤니티 기반 보완 장치를 더 전면에 내세우고 있다. 메타는 2025년 1월 콘텐츠 검토 정책을 대폭 개편했다. 미국에서 제3자 팩트체킹을 종료하고 X(구 트위터)의 ‘커뮤니티 노트(Community Notes)’ 모델로 전환하기로 발표했다. 저커버그는 이 결정을 “표현의 자유로 돌아가기 위한 선택”이라고 설명했다. 단순한 정책 변경이 아니라 과잉 검열, 정치적 편향, 표현의 자유를 둘러싼 수년간의 논쟁이 응축된 결과였다.

메타는 2025년 1월 공식 발표에서 최근 몇 년간 콘텐츠 관리 체계가 너무 복잡해지면서 실수가 너무 많아졌고 무해한 콘텐츠까지 과도하게 차단하게 되었다고 설명했다. 실제로 2024년 12월 기준 매일 삭제된 수백만 건 콘텐츠(전체 생성량의 1% 미만) 중 10건 중 1~2건은 오류일 가능성을 제기했다. 이에 따라 자동화된 콘텐츠 모더레이션은 아동 성 착취, 마약, 사기 등 불법적이고 심각도가 높은 위반 사항에 집중하고, 심각도가 낮은 정책 위반은 이용자 신고가 들어온 경우에 한해 대응할 예정이라고 밝혔다.20

유튜브는 자동화된 시스템과 인간 검토 조합 구조를 설명하면서 대다수의 사례에서 자동 시스템이 인간 검토자에게 플래그를 넘긴다고 명시하고 있다.21 최근 공개된 보고서에 따르면 2025년 10월~12월 삭제된 영상은 총 863만4204개로 이 중 98.1%(847만3946개)가 AI 기반 자동 플래깅으로 먼저 탐지됐다. 삭제된 영상의 42.26%는 조회수 0회 상태에서, 41.41%는 1~10회 조회 시점에서 차단됐다. 대부분의 문제 콘텐츠가 광범위하게 확산되기 전에 선제적으로 처리되고 있다는 의미다.22

메타는 2025년 3분기 집행 보고서에서 미국 내 오류 감소 현황을 공유했다. 페이스북과 인스타그램에서 정책 위반으로 삭제된 콘텐츠는 전체의 1% 미만이었다. 삭제된 콘텐츠 중 올바르게 삭제된 비율 ‘집행 정확도’는 페이스북 90% 이상, 인스타그램 87% 이상으로 나타났다. 이는 삭제 콘텐츠 10개 중 약 1개, 전체 생성 콘텐츠 1000개 중 1개 미만이 오류로 삭제됐음을 의미한다.23

한편 메타의 인간 모더레이터들은 페이스북, 인스타그램, 스레드(Threads) 등 전반에서 24시간 콘텐츠를 검토하며 80개 이상의 언어로 아동 성착취, 혐오표현, 폭력·테러, 선거·정치 관련 위반을 다루고 있다.

나아가 메타는 외부 전문가들로 구성된 독립 심의 기구 ‘오버사이트 보드(Oversight Board)’를 운영한다. 이용자가 메타 내부 항소 절차를 모두 거친 뒤 신청하거나, 메타가 직접 회부한 적격 사건에 대해 보드가 선택적으로 심리하는 구조다. 개별 사건 결정은 원칙적으로 메타에 구속력이 있지만, 정책 권고는 비구속적이다.

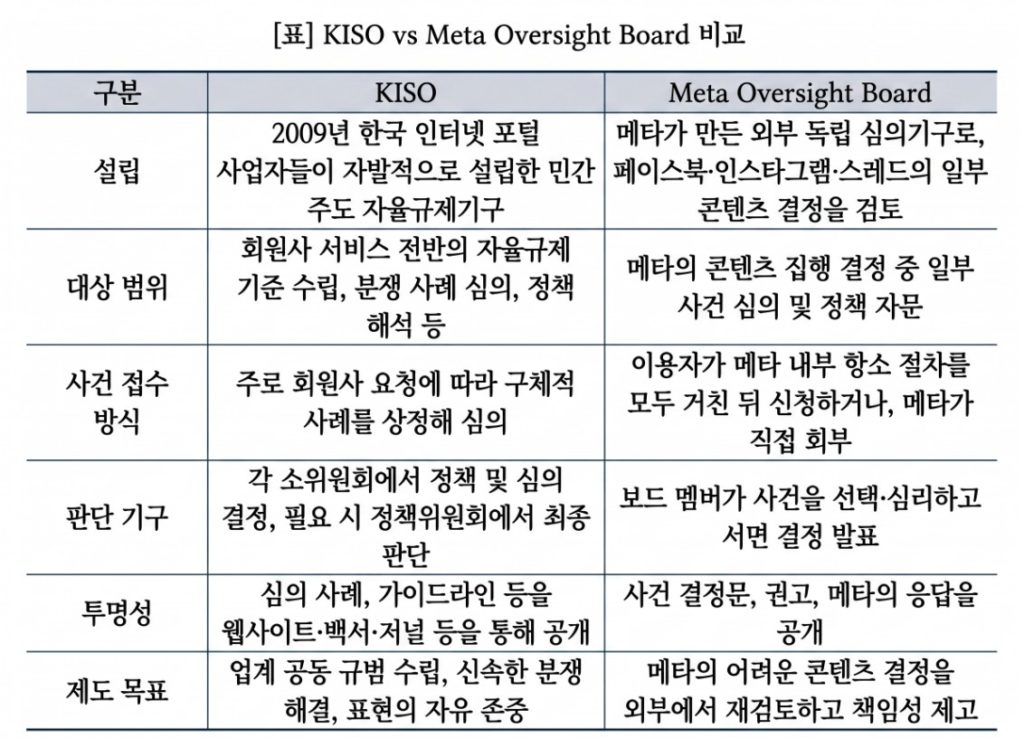

이 오버사이트 보드는 한국인터넷자율규제기구(이하 KISO)와 여러 면에서 비교된다. 두 기구 모두 비사법적 외부 심의 구조를 갖추고, 전문가 집단의 판단을 통해 개별 사건을 넘어 규범 개선 기능까지 수행한다는 점에서 공통점이 있다. 다만, KISO가 국내 인터넷 포털 사업자들이 자발적으로 설립한 업계 공동 자율규제 기구라면 오버사이트 보드는 단일 기업(메타)의 콘텐츠 결정을 외부에서 재검토하는 기관이다. 아래 표는 두 기구의 주요 특징을 비교한 것이다.

틱톡의 상황도 크게 다르지 않다. 틱톡은 2025년 4분기 전 세계에서 총 1억7500만 건의 동영상을 삭제했는데, 이는 전체 업로드 콘텐츠의 약 0.5%에 해당한다. 이 중 1억5259만 건은 자동 탐지 기술로 식별돼 삭제됐으며, 사전 차단율은 99.1%, 신고된 콘텐츠의 93.4%는 게시 후 24시간 이내에 삭제됐다.24

앞서 틱톡은 2024년 상반기 터키에서 약 710만 건의 영상을 삭제했는데, 이 중 80%가 자동화 시스템 처리였고, 98%는 이용자가 보기 전에 차단됐다.25 자동화의 효율성을 보여주는 동시에, 오류 발생 시 그 영향이 얼마나 광범위할 수 있는지를 가늠하게 한다.

X(구 트위터)는 정책 영역별로 자동화 비율이 편차를 보인다. ‘플랫폼 조작·스팸’ 분야는 계정 정지 기준 자동화 비율이 99.9%에 달하는 반면, 혐오 발언·괴롭힘처럼 맥락 이해가 필수적인 영역은 거의 전적으로 인간 검토에 의존한다. 전체 게시물 위반율(Post Violation Rate)은 모든 카테고리에서 0.01% 미만으로 낮게 보고된다.26

라. 국내 플랫폼 및 KISO 사례

국내 플랫폼들도 자체 AI 모더레이션을 고도화하고 있다. 네이버 ‘클린봇’은 단순 금칙어 차단이 아니라 문장 전체의 맥락을 분석해 모욕적·무례한 댓글까지 탐지하는 문맥 기반 악성 표현 탐지 모델로 고도화됐다.27 카카오 ‘세이프봇’은 욕설·비속어를 음표로 치환하고, 다른 이용자에게 불쾌감을 줄 수 있는 댓글은 가린 뒤 신고 처리까지 완료하는 구조로 설계됐다. 파생된 욕설이나 다양한 변형 조합도 식별하는 한편, 잘못된 분류로 선의의 이용자가 피해를 입지 않도록 화이트리스트도 운영한다.28

KISO의 KSS(KISO Safeguard System)는 개별 기업 차원의 노력을 업계 공동 인프라로 확장한 사례다. 포털 회원사로부터 제공받은 욕설·비속어 데이터베이스를 기반으로 개발된 API 방식의 이용자보호 시스템으로 2023년 6월 정식 출시됐다. 이후 2025년에는 네이트 DB가 추가되면서 국내 3대 포털의 80여만 건 욕설·비속어 DB가 KSS에 반영됐고, 42개 기관 및 업체에서 20만 건이 넘는 욕설·비속어가 탐지·차단됐다.29 개별 기업의 자율조치를 넘어 ‘업계 공동 인프라+공개된 정책 기준’이라는 조합으로 한국형 자율규제가 발전하고 있음을 보여주는 사례이다.

KISO는 설립 초기부터 시장 자율과 이용자 권리 보호라는 두 과제를 안고, 전문가 기반 심의와 가이드라인 제정을 통해 국내 자율규제 모델을 만들어왔다. 이 경험은 자율규제가 기술 변화에 어떻게 대응해야 하는지를 가늠하게 한다.

3. 결론

‘AI+인간’ 모더레이션 사례들이 공통적으로 보여주는 것은 맥락과 규범의 문제는 여전히 인간의 판단이 필요한 영역이라는 점이다. 그리고 그 인간의 판단이 기업 내부에만 머물 때, 정당성 확보가 어려워진다.

KISO는 플랫폼과 이용자, 시민사회, 학계·전문가를 연결하는 중간 매개로서, 정책 기준을 공동으로 정립하고 분쟁 사안을 숙의적으로 조정하는 기능을 수행해왔다. 기술 인프라(KSS)와 규범 체계(정책위원회·소위원회·가이드라인)을 함께 운영해 온 경험은 향후 더 정교한 거버넌스 구조를 설계하는 토대가 된다. 혐오표현, 허위조작정보, 생성형 AI 콘텐츠처럼 판단의 복잡성이 높은 영역으로 자율규제를 확장할 때 중요한 참조점이 될 수 있다.

AI가 탐지하고 인간이 검토하며 외부 기구가 심의하는 구조가 투명하게 작동할 때, 콘텐츠 모더레이션은 기술의 문제를 넘어 신뢰의 문제로 자리 잡게 될 것이다.

- New York Times. (2026, February 21). People Loved the Dot-Com Boom. The A.I. Boom, Not So Much. Retrieved April 21, 2026, from https://www.nytimes.com/2026/02/21/technology/ai-boom-backlash.html. [본문으로]

- Hartono, B., Suasana, I. S., Muthohir, M., Suresh, R., & Prihatmoko, S. (2025). Sociotechnical perspectives on balancing human judgment and AI in content moderation. In Proceedings of the 2025 4th International Conference on Creative Communication and Innovative Technology (ICCIT) p.1. [본문으로]

- 김희진. (2026). AI 기반 콘텐츠 모더레이션 (algorithmic content moderation) 자동화에 대한 기술적‧규범적 분석 및 규제 대응 방안. 저스티스. 207면. [본문으로]

- Lykouris, T., & Weng, W. (2024). Learning to defer in congested systems: The AI-human interplay. [본문으로]

- Hartono et al., op. cit., p.1. [본문으로]

- Palla, K., Damianou, A., Lalmas, M., García, J. L. R., Hauff, C., Fabbri, F., Lindström, H., & Taber, D. (2025). Policy-as-prompt: Rethinking content moderation in the age of large language models. In Proceedings of the 2025 ACM Conference on Fairness, Accountability, and Transparency (FAccT ’25). p.840. [본문으로]

- Ibid. p.840. [본문으로]

- 김희진. (2026). 앞의 논문. 207면. [본문으로]

- DIGITAL iNSIGHT. (2025.2.16.). 20주년 맞은 유튜브, 하루 평균 업로드 영상 개수는? https://ditoday.com/20%EC%A3%BC%EB%85%84-%EB%A7%9E%EC%9D%80-%EC%9C%A0%ED%8A%9C%EB%B8%8C-%ED%95%98%EB%A3%A8-%ED%8F%89%EA%B7%A0-%EC%97%85%EB%A1%9C%EB%93%9C-%EC%98%81%EC%83%81-%EA%B0%9C%EC%88%98%EB%8A%94/.(2026. 4. 21. 방문). [본문으로]

- Social Media Today. (2024.12.17). What happens on the internet every minute (2024 version). Retrieved April 21, 2026, from https://www.socialmediatoday.com/news/what-happens-online-every-minute-2024/735990/. [본문으로]

- Huang, T. (2025). Content moderation by LLM: from accuracy to legitimacy. Artif Intell Rev 58. p.320. [본문으로]

- Hendrix, J., Iyer, P., & Miller, G. (2024, January 31). Transcript: US Senate Judiciary Committee hearing on “Big Tech and the Online Child Sexual Exploitation Crisis”. TechPolicy.Press. Retrieved April 24, 2026, from https://www.techpolicy.press/transcript-us-senate-judiciary-committee-hearing-on-big-tech-and-the-online-child-sexual-exploitation-crisis/. [본문으로]

- Gulevičiūtė, G., Mačiulienė, M., Skaržauskienė, A., Zelenkauskaitė, A., & Diržytė, A. (2025). A Comparative Analysis of Social Networks Content Moderation Guidelines and Blog Posts. Journal of Entrepreneurship & Sustainability Issues, 12(4), p.118. [본문으로]

- Hartmann, D., Oueslati, A., Staufer, D., et al. (2025). Lost in moderation: How commercial content moderation APIs over- and under-moderate group-targeted hate speech and linguistic variations. arXiv. [본문으로]

- Dexerto. (2025. 12. 10.) “Pokemon YouTuber banned by AI finally gets channel back after creator stole his video, https://www.dexerto.com/youtube/pokemon-youtuber-banned-by-ai-as-channel-steals-their-video-but-youtube-wont-budge-3291898/. [본문으로]

- Levi, A., Levi, O., Mishra, S., & Morra, J. (2025). AI vs. human moderators: A comparative evaluation of multimodal LLMs in content moderation for brand safety. In 2025 IEEE/CVF International Conference on Computer Vision Workshops (ICCVW). IEEE. p.6024. [본문으로]

- Levi et al. (2025). pp. 6030-6031. [본문으로]

- 박엘리. (2026). 웹툰 내 혐오표현 자율규제 방안 연구: 표현의 자유와 매체적 특성을 중심으로. 96면. [본문으로]

- 황용석. (2023). 온라인 혐오표현 규제는 왜 어려운가?. KISO 저널,(53), 45-46면. [본문으로]

- Kaplan, J. (2025.1.7.). More Speech and Fewer Mistakes. Meta 블로그. Retrieved April 23, 2026, from https://about.fb.com/news/2025/01/meta-more-speech-fewer-mistakes/. [본문으로]

- YouTube. (n.d.). How YouTube reviews content. Google. Retrieved April 23, 2026, from https://support.google.com/youtube/answer/13304829?hl=en. [본문으로]

- Google. (2026). YouTube 커뮤니티 가이드 시정 조치: 2025년 4분기. 투명성 보고서. Retrieved April 24, 2026, from https://transparencyreport.google.com/youtube-policy/removals?total_removed_videos=period:2025Q4;exclude_automated:all&lu=total_removed_videos. [본문으로]

- Meta. (2025). Integrity reports, third quarter 2025. Transparency Center. Retrieved April 24, 2026, from https://transparency.meta.com/reports/integrity-reports-q3-2025/. [본문으로]

- Technology Khabar. (2026, April 17). TikTok releases Q4 2025 Community Guidelines Enforcement Report. Retrieved April 24, 2026, from https://www.technologykhabar.com/2026/04/17/236975/. [본문으로]

- Hürriyet Daily News. (2026, April). TikTok removes 7M videos in 6 months over guideline breaches. Retrieved April 24, 2026, from https://www.hurriyetdailynews.com/tiktok-removes-7m-videos-in-6-months-over-guideline-breaches-203678. [본문으로]

- X Corp. (2026). 2025 Transparency Report. Retrieved April 24, 2026, from https://transparency.x.com/en/reports/global-reports/2025-transparency-report. [본문으로]

- 네이버. (2023. 7. 20.)클린봇(악플 차단 AI). 네이버 그린인터넷. https://green.naver.com/greeninternet-create-home/rMS6PwC0. [본문으로]

- 카카오. (2022. 12. 14.). 카카오, 뉴스 댓글 서비스에 ‘세이프봇’ 적용 성과 공개. https://www.kakaocorp.com/page/detail/9849. [본문으로]

- 한국인터넷자율정책기구. (2025, 7. 11.). [보도자료] KISO 욕설방지시스템(KSS)에 네이트 DB 추가. https://www.kiso.or.kr/kiso-%ec%86%8c%ec%8b%9d/%eb%b3%b4%eb%8f%84%ec%9e%90%eb%a3%8c/?mod=document&uid=1453. [본문으로]

다음 글

다음 글  국내외 IT 기업들의 ESG 경영 소개

국내외 IT 기업들의 ESG 경영 소개  FCC의 망중립성 규정 폐지 및 국내 영향

FCC의 망중립성 규정 폐지 및 국내 영향  AI 에이전트가 ‘킬러앱’ 될까?

AI 에이전트가 ‘킬러앱’ 될까?  국내외 급부상 중인 슈퍼앱 현황 및 사례와 전망

국내외 급부상 중인 슈퍼앱 현황 및 사례와 전망  데이터 배당(Data dividend) 도입 추진 배경과 전망

데이터 배당(Data dividend) 도입 추진 배경과 전망  국내 포털의 부동산 정보서비스 개괄 및 자율규제 현황

국내 포털의 부동산 정보서비스 개괄 및 자율규제 현황  빅데이터 관련 개인정보 비식별화 정부 가이드라인 수립 – 미국 등 주요국 가이드라인 비교

빅데이터 관련 개인정보 비식별화 정부 가이드라인 수립 – 미국 등 주요국 가이드라인 비교  ‘메타(Meta), EU 사용자에게 맞춤형 광고 선택권 부여 합의’

‘메타(Meta), EU 사용자에게 맞춤형 광고 선택권 부여 합의’