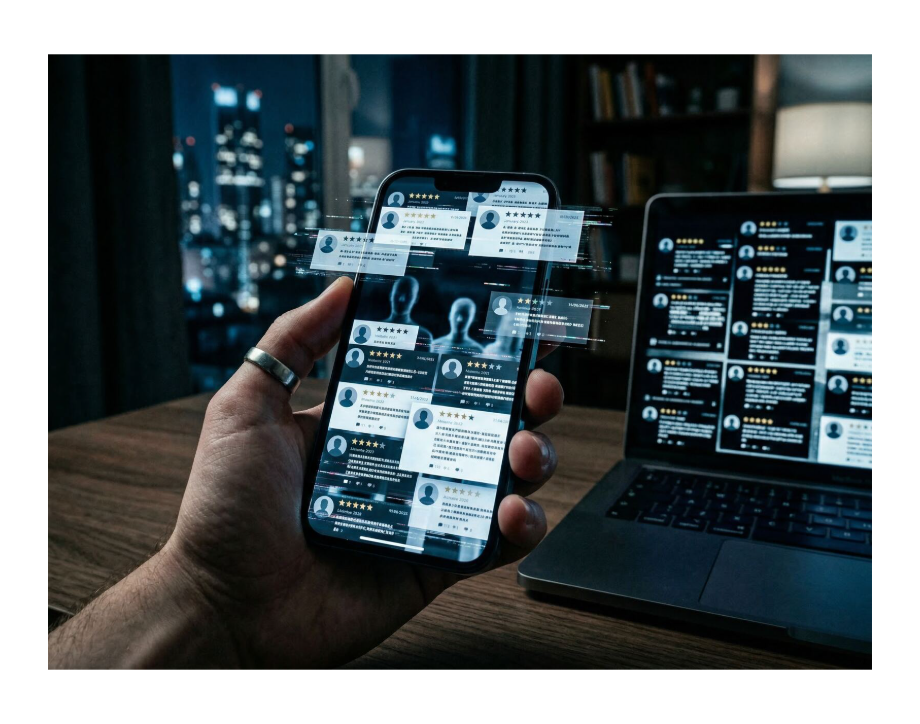

리뷰를 읽는다, 그런데 누가 쓴 것인가 : AI 생성 리뷰 시대, 온라인 신뢰의 구조적 위기

우리는 왜 리뷰를 믿어 왔는가

물건을 사기 전, 많은 사람들이 리뷰를 먼저 찾는다. 공식 설명보다 구매 후기가 더 궁금하고, 별점보다 누군가의 실제 경험담이 더 와 닿는다. 직접 써 본 사람의 솔직한 한마디가 수십 개의 제품 사양보다 결정적으로 느껴질 때가 많다.

이 감각의 바탕에는 리뷰가 ‘진짜 사람의 이야기’라는 전제가 있다. 리뷰를 읽는다는 건 낯선 누군가의 경험을 빌려 오는 일이고, 그 경험을 통해 자신의 선택에 확신을 얻는 과정이다. 구매라는 결정을 혼자 내리는 것이 아니라, 먼저 경험한 수많은 사람들의 목소리를 참고해 내리는 셈이다. 이런 의미에서 리뷰는 단순한 정보가 아니라, 소비자들이 서로의 경험을 믿고 나누는 암묵적인 약속 위에서 작동한다.

그런데 최근 들어 이 신뢰 관계가 흔들리고 있다. 많은 소비자들이 리뷰를 의심하면서도 여전히 리뷰를 보고 구매를 결정한다. 믿지 않으면서 믿을 수밖에 없는 이 어색한 상황의 중심에 사람처럼 글을 쓰는 생성형 AI가 있다.

가짜 리뷰는 늘 있었다, 하지만 지금은 다르다

가짜 리뷰가 어제오늘의 문제는 아니다. 제품을 팔기 위해 없는 경험을 꾸며 쓰거나, 경쟁사를 깎아내리는 리뷰를 올리는 행위는 전자상거래 초창기부터 있어 왔다. Luca & Zervas(2016)에 따르면 Yelp에 게재된 식당 리뷰 중 약 16%가 의심스러운 것으로 분류될 만큼 가짜 리뷰는 이미 온라인 소비 문화의 고질적인 문제였다.

그러나 그때의 가짜 리뷰에는 티가 났다. “최고입니다!! 강추해요!!” 같은 지나친 감탄사, 제품과 동떨어진 뜬금없는 표현, 어색하게 반복되는 문구들. 독자들은 그런 단서들을 접하는 순간 자연스럽게 경계심을 가졌고, 진짜와 가짜를 나름대로 구분해 낼 수 있었다.

생성형 AI가 등장하면서 상황이 달라졌다. AI는 지나치지 않게 긍정적이고, 그럴듯한 단점 한두 가지도 곁들이며, 실제 사용자처럼 느껴지는 구체적인 표현을 자연스럽게 배치한다. 단순히 문법이 맞는 문장을 만드는 수준이 아니다. AI는 소비자들이 신뢰할 만한 리뷰라고 느끼는 형식과 어조 자체를 학습했다.

문제는 가짜 리뷰가 많아졌다는 데 있지 않다. 가짜 리뷰가 더 이상 가짜처럼 보이지 않는다는 데 있다.

Salminen et al.(2021)의 연구에서는 소비자들이 AI가 작성한 리뷰와 실제 사람이 작성한 리뷰를 구별하는 데 상당한 어려움을 겪는다는 사실이 확인되었다. 과장된 표현이나 어색한 문구 같은 단서들을 이미 AI가 능숙하게 피해 가고 있기 때문이다.

매끄러운 문장이 오히려 의심을 무너뜨린다

왜 AI가 쓴 리뷰가 이토록 쉽게 신뢰를 얻는 걸까. 그 답은 역설적이게도 AI 글쓰기의 특성보다 인간 독해의 특성에 있다.

Oppenheimer(2008)는 읽기 편하고 매끄럽게 흘러가는 문장을 접했을 때 사람들이 그 내용을 더 정확하고 믿을 만하다고 느끼는 경향이 있다는 것을 밝혔다. 이를 ‘유창성 휴리스틱(fluency heuristic)’이라고 한다. 문장이 잘 읽히면 내용도 맞는 것처럼 느껴지는, 일종의 착각이다.

AI가 쓴 리뷰는 이 기제를 정확하게 자극한다. 문장이 깔끔하게 정돈되어 있고, 감정 표현이 과하지 않으며, 논리가 매끄럽게 연결된다. 독자는 자신이 경험의 진정성을 판단하고 있다고 생각하지만, 실제로는 글의 완성도에 반응하고 있을 가능성이 크다. “이 사람이 정말 써 봤을까?”가 아니라 “이 글이 그럴듯하게 읽히는가?”가 판단의 기준으로 작동하고 있는 것이다.

사람이 쓰고 AI가 다듬으면, 책임은 누구에게 있는가

오늘날 리뷰를 둘러싼 환경을 보면 인간과 AI를 명확히 구분하는 것 자체가 점점 의미를 잃고 있다. 가장 흔한 방식은 사람이 경험을 대략 적고 AI가 문장을 다듬는 형태다. 직접 제품을 써 본 사람이 느낌을 몇 줄 입력하면, AI가 그것을 자연스럽고 설득력 있는 문장으로 바꿔 준다. 최종 결과물은 사람의 경험에서 출발했지만, 독자에게 닿는 언어는 AI가 만들어 낸 것이다.

이 인간-AI 협업 리뷰는 읽기에는 가장 자연스럽지만, 책임의 주체는 가장 모호하다. 실제 경험과 다르게 표현이 부풀려졌다면, 혹은 모호했던 느낌이 확신에 찬 문장으로 바뀌었다면, 그것은 작성자의 의도인가, AI의 결과인가. 이 질문은 단순히 윤리의 문제가 아니다. 누가 판단하고 누가 책임지는지가 불분명해질수록 소비자들 사이에 쌓여 온 신뢰도 함께 허물어진다.

Skitka et al.(1999)은 사람들이 자동화 시스템을 ‘도와주는 도구’로 사용할 때는 자신의 판단에 책임감을 유지하지만, ‘대신 결정해 주는 존재’처럼 느끼기 시작하면 책임감이 희석되는 경향이 있다고 지적했다. 이른바 자동화 편향(automation bias)이다. 리뷰 작성에서도 같은 일이 일어난다. AI가 문장 전체를 만들어 내는 순간, 그 글에 담긴 판단의 주인이 누구인지 모호해진다.

소비자의 판단 기준이 조용히 무너지고 있다

소비자 입장에서도 상황이 녹록지 않다. 사람들은 대체로 자신이 가짜 리뷰를 알아볼 수 있다고 생각한다. 지나치게 완벽한 문장, 결점 없는 칭찬 일색, 격식 차린 표현. 이런 단서들을 포착하면 의심한다고 스스로 믿는다.

그런데 그 단서들을 AI가 이미 정교하게 우회하고 있다. AI는 적당한 단점을 넣어 주고, 구어체 표현도 자연스럽게 섞으며, 감정의 온도를 리뷰답게 조절한다. 소비자가 ‘사람이 쓴 글의 특징’이라고 믿어 왔던 것들이 이제는 AI가 가장 잘 흉내 내는 항목이 된 셈이다.

더 큰 문제는 소비자가 더 이상 예전의 방식으로 리뷰를 걸러 낼 수 없게 됐다는 점이다. 과거에는 어색한 문장이나 과도한 칭찬 같은 눈에 띄는 단서들이 있었다. 이제는 그런 단서 자체가 사라졌다. AI가 쓴 글이 매끄럽고 균형 잡혀 있으니, 오히려 잘 쓴 리뷰일수록 믿기 어려운 역설이 생겨난 것이다. 소비자가 더 열심히 읽고 더 주의를 기울여도 해결되지 않는 이유가 여기에 있다. 예전 같은 단서가 없으니, 주의를 기울여도 무엇을 주의 깊게 봐야 할지 알기 어렵다.

신뢰는 결국 시장이 지킨다

이 문제의 해법을 찾을 때 가장 먼저 떠오르는 생각은 ‘규제’다. 플랫폼에 의무를 부과하고 AI 생성 리뷰에 법적 제한을 두자는 목소리도 있다. 그러나 규제는 이 문제의 본질과 잘 맞지 않는다. AI 탐지 기술이 발전하면 탐지를 피하는 기술도 함께 발전하고, 법이 특정 형태의 가짜 리뷰를 금지하면 그 경계를 비껴 가는 새로운 방식이 생겨난다. 기술로 기술을 막는 방식은 언제나 뒤쫓는 게임에 가깝다.

오히려 주목해야 할 것은 시장 자체가 가진 자정 능력이다. 가짜 리뷰가 넘쳐나는 플랫폼에서 소비자는 발길을 돌리고, 잘못된 정보를 믿고 구매한 소비자는 다시 돌아오지 않는다. 결국 신뢰를 잃은 플랫폼은 사용자를 잃고, 사용자를 잃으면 광고 수익도 거래 수수료도 사라진다. Yelp가 일찍부터 자체 필터링 알고리즘을 개발하고(Luca & Zervas, 2016), 아마존이 가짜 리뷰 작성자를 상대로 소송을 제기해 온 것은 도덕적 의무 때문이 아니라, 플랫폼의 신뢰가 곧 수익의 원천이기 때문이다.

물론 시장이 모든 것을 알아서 해결해 줄 거라는 낙관도 경계해야 한다. 가짜 리뷰는 단기적으로 판매에 효과적이고, 소비자가 그 피해를 알아차리기까지는 시간이 걸린다. 이 간극에서 판매자와 소비자 사이의 정보 불균형이 생겨난다. 이때 정책의 역할은 플랫폼을 옥죄는 것이 아니라, 소비자가 더 나은 판단을 내릴 수 있도록 정보 접근성을 높이는 데 있다. 실제로 일부 플랫폼들은 이미 자발적으로 AI 작성 여부를 표기하는 방향으로 움직이고 있다. 소비자들이 그것을 원하기 때문이다. 어떤 리뷰가 AI의 손을 거쳤는지 알 수 있다면, 소비자는 그 사실을 하나의 참고 정보로 삼아 스스로 판단할 수 있다. 선택은 여전히 소비자의 몫이다.

소비자 스스로도 달라져야 한다

장기적으로 가장 중요한 변화는 소비자 스스로가 정보를 읽는 방식을 바꾸는 것이다. 리뷰 하나하나의 진위를 가려 내려는 노력보다, 단일 리뷰에 지나치게 의존하지 않는 습관이 더 현실적인 대응이다. 여러 출처를 교차 확인하고, 너무 매끄럽고 정형화된 리뷰에는 오히려 한발 물러서는 감각을 키워야 한다. 아이러니하게도 읽기 너무 편한 글을 조금 더 의심해야 하는 시대가 됐다.

이것은 소비자를 불신으로 내모는 이야기가 아니다. 정보 환경이 바뀌면 그 환경을 읽는 방식도 함께 바뀌어야 한다는 이야기다.

사람처럼 쓰는 AI 자체가 문제가 아니다. 그 뒤에 아무도 책임지지 않는 구조가 문제다.

리뷰는 낯선 사람의 경험을 빌려 내 결정을 돕는 행위다. 그 경험이 진짜인지, 그 판단이 누군가의 것인지 알 수 없게 되는 순간, 리뷰는 정보가 아니라 소음이 된다. 기술이 아무리 빠르게 변해도, 신뢰는 결국 사람이 만들고 사람이 지키는 것이다.

<참고문헌>

[1] Luca, M., & Zervas, G. (2016). Fake it till you make it: Reputation, competition, and Yelp review fraud. Management Science, 62(12), 3412–3427.

[2] Oppenheimer, D. M. (2008). The secret life of fluency. Trends in Cognitive Sciences, 12(6), 237–241.

[3] Salminen, J., Kandpal, C., Kamel, A. M., Jung, S., & Jansen, B. J. (2021). Creating and detecting fake reviews of online products. Journal of Retailing and Consumer Services, 64, 102771.

[4] Skitka, L. J., Mosier, K., & Burdick, M. (1999). Does automation bias decision-making? International Journal of Human-Computer Studies, 51(5), 991–1006.

이전 글

이전 글  다음 글

다음 글  AI가 ‘추천’을 넘어 ‘대신 쇼핑’하는 시대

AI가 ‘추천’을 넘어 ‘대신 쇼핑’하는 시대  ‘메타(Meta), EU 사용자에게 맞춤형 광고 선택권 부여 합의’

‘메타(Meta), EU 사용자에게 맞춤형 광고 선택권 부여 합의’  가상에서 실체로, CES 2026을 통해 본 ‘AI Everywhere’ 시대

가상에서 실체로, CES 2026을 통해 본 ‘AI Everywhere’ 시대  ‘혐오 바이러스’ 확산, 그리고 기업의 책임

‘혐오 바이러스’ 확산, 그리고 기업의 책임  ‘표현의 자유와 공익의 균형’ 정보통신망법 개정과 자율규제: 허위조작정보를 중심으로

‘표현의 자유와 공익의 균형’ 정보통신망법 개정과 자율규제: 허위조작정보를 중심으로  한국사회의 온라인 혐오 극복과 자율규제의 중요성

한국사회의 온라인 혐오 극복과 자율규제의 중요성  청소년 SNS 금지를 둘러싼 글로벌 법제 동향: 호주, 프랑스, 미국을 중심으로

청소년 SNS 금지를 둘러싼 글로벌 법제 동향: 호주, 프랑스, 미국을 중심으로  ‘무한 정보세상’에서 점점 더 소중해지는 것은?

‘무한 정보세상’에서 점점 더 소중해지는 것은?